A evolução da inteligência artificial tem ampliado fronteiras — e responsabilidades. À medida que sistemas inteligentes passam a interagir com aplicações empresariais, bases de dados sensíveis e serviços conectados à internet, o debate sobre segurança deixa de ser periférico e assume posição central nas agendas executivas.

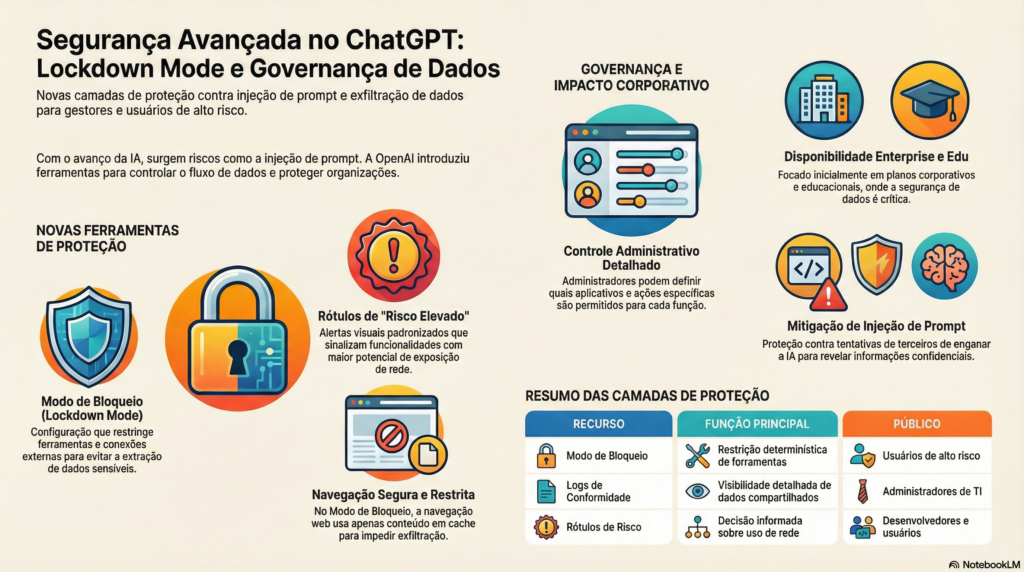

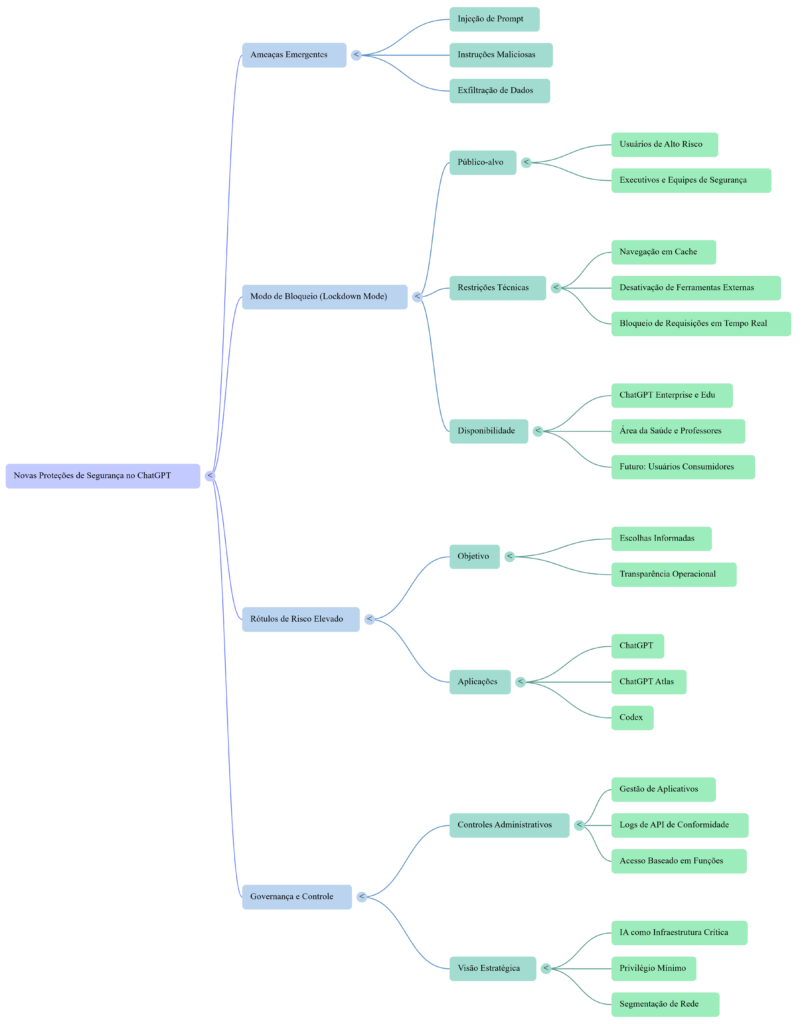

Recentemente, a OpenAI anunciou novos mecanismos voltados à mitigação de riscos emergentes associados à manipulação de modelos por instruções maliciosas — uma ameaça crescente em ambientes onde agentes inteligentes executam tarefas reais. Entre as iniciativas estão o Lockdown Mode e a introdução de etiquetas de risco elevado para determinadas capacidades do sistema.

A comunicação oficial pode ser acessada no anúncio publicado pela organização:

https://openai.com/index/introducing-lockdown-mode-and-elevated-risk-labels-in-chatgpt/

Mais do que recursos técnicos, essas medidas sinalizam uma mudança estrutural no posicionamento da inteligência artificial dentro das empresas: a IA passa a ser tratada como infraestrutura crítica, exigindo controles semelhantes aos aplicados a redes corporativas, ambientes em nuvem e sistemas financeiros.

O Lockdown Mode permite restringir interações externas, reduzindo a superfície de exposição e protegendo dados estratégicos contra tentativas de extração indevida. Essa abordagem reflete princípios consolidados de segurança — como privilégio mínimo e segmentação — agora aplicados ao contexto de agentes inteligentes.

Já as etiquetas de risco elevado ampliam a transparência operacional ao informar quando determinadas funcionalidades podem aumentar a exposição do ambiente. Para líderes e gestores, isso representa um avanço na governança tecnológica, permitindo decisões mais conscientes sobre equilíbrio entre capacidade operacional e proteção.

Para o ambiente corporativo, o impacto estratégico é claro:

- A inteligência artificial está migrando de ferramenta experimental para componente essencial da arquitetura empresarial

- Segurança e governança tornam-se fatores determinantes de adoção

- Transparência e controle passam a ser requisitos para compliance e auditoria

- A gestão de risco em IA aproxima-se cada vez mais das práticas consolidadas em cloud e cibersegurança

Esse movimento indica um amadurecimento do setor e reforça uma tendência: organizações que estruturarem desde já políticas claras de adoção e proteção estarão melhor posicionadas para capturar valor sustentável dessas tecnologias.

Ajudando organizações a proteger os funcionários mais vulneráveis a ataques cibernéticos

De acordo com a fonte oficial da OpenAI, “O Modo de Bloqueio é uma configuração de segurança avançada e opcional, projetada para um pequeno grupo de usuários altamente preocupados com a segurança — como executivos ou equipes de segurança em organizações importantes — que exigem maior proteção contra ameaças avançadas. Para a maioria dos usuários, não é necessário. O Modo de Bloqueio restringe rigorosamente a forma como o ChatGPT pode interagir com sistemas externos para reduzir o risco de exfiltração de dados baseada em injeção imediata.

O Modo de Bloqueio desativa de forma determinística certas ferramentas e funcionalidades do ChatGPT que um adversário poderia tentar explorar para extrair dados sensíveis das conversas dos usuários ou de aplicativos conectados por meio de ataques como injeções de prompts.

Por exemplo, a navegação na web no Modo de Bloqueio é limitada ao conteúdo em cache, portanto, nenhuma solicitação de rede em tempo real sai da rede controlada pela OpenAI. Essa restrição foi criada para impedir que dados sensíveis sejam exfiltrados para um invasor por meio da navegação. Algumas funcionalidades são completamente desativadas quando não podemos fornecer garantias determinísticas robustas de segurança de dados.

Os planos de negócios do ChatGPT já oferecem segurança de dados de nível empresarial. O Modo de Bloqueio amplia essas proteções e está disponível para ChatGPT Enterprise, ChatGPT Edu, ChatGPT para a Área da Saúde e ChatGPT para Professores. Os administradores podem habilitá-lo nas Configurações do Espaço de Trabalho (abre em uma nova janela) criando uma nova função (abre em uma nova janela). Quando ativado, o Modo de Bloqueio adiciona restrições extras às configurações administrativas existentes.”

Quer explorar como implementar IA de forma estratégica e segura em seu ambiente corporativo?

Na InfoChoice, acompanhamos de perto essa evolução e apoiamos empresas na avaliação, integração e governança segura de soluções baseadas em inteligência artificial — conectando inovação a responsabilidade operacional.

Converse com nosso Assistente Dgital (a bolinha azul pulsante no canto inferior direito do site) ou preencha o formulário de contato e fale com nossos especialistas.

Podcast e Análise Imersiva

Infográfico

Mapa Mental

ESTRUTURA DA SÉRIE ESPECIAL

Segurança da Informação – AGENTES DE IA

Segurança de agentes de IA na era da inteligência artificial

2️⃣ Artigo 1

Prompt Injection: o novo phishing da era da IA

3️⃣ Artigo 2

Como projetar agentes de IA resistentes a prompt injection

4️⃣ Artigo 3

A superfície de ataque de agentes de IA

5️⃣ Artigo 4

Kill chain de ataques contra agentes de IA

Lockdown Mode e Segurança em IA: o que a nova iniciativa da OpenAI revela sobre o futuro corporativo

Cibersegurança em 2026: IA, Guerra Digital e a Nova Era das Ameaças Cibernéticas

Artigo Bônus

Governança Autônoma: como agentes de IA estão redefinindo segurança e compliance

Deixe um comentário