Categoria: Segurança da Informação

-

Trusted Contact: por que o novo recurso do ChatGPT marca o início da IA responsável em escala

A OpenAI lançou o Trusted Contact no ChatGPT e inaugurou uma nova discussão sobre confiança, governança e responsabilidade em inteligência artificial. Entenda por que esse movimento pode redefinir o futuro dos agentes inteligentes e da IA corporativa.

-

Segurança de Agentes de IA: o risco já saiu do laboratório — e sua empresa pode não estar vendo

Agentes de IA já fazem parte da operação das empresas — mas a segurança não evoluiu no mesmo ritmo. Este artigo revela os riscos reais, como o fenômeno do Shadow AI, falhas de governança e a necessidade urgente de uma nova abordagem baseada em comportamento.

-

Trusted Access: o novo modelo de governança para IA de alto risco – Como a iniciativa da OpenAI redefine segurança, identidade e controle no uso de inteligência artificial avançada

A governança de inteligência artificial está evoluindo rapidamente. Com o conceito de Trusted Access, a OpenAI introduz um novo modelo baseado em identidade e controle de acesso, redefinindo como empresas devem proteger, gerenciar e escalar o uso de IA de forma segura.

-

Cibersegurança na Era da IA: o que o Relatório Global 2025 revela sobre riscos, comportamento humano e o futuro da proteção digital

O relatório global de 2025 da Fortinet revela um cenário paradoxal: enquanto a inteligência artificial aumenta a percepção de risco nas organizações, o comportamento humano ainda representa a principal vulnerabilidade. Este artigo explora os principais insights do estudo e mostra como transformar conscientização em uma cultura real de segurança.

-

Threat Hunting na Prática: Como a Trellix Está Redefinindo a Defesa Proativa contra Ameaças Avançadas

Análise estratégica do relatório Trellix SecondSight 2026 e como o threat hunting proativo está transformando a cibersegurança moderna.

-

Governança Autônoma: como agentes de IA estão redefinindo segurança e compliance

Agentes de IA estão redefinindo segurança e compliance, transformando processos manuais em governança contínua e orientada por contexto. Entenda essa mudança.

-

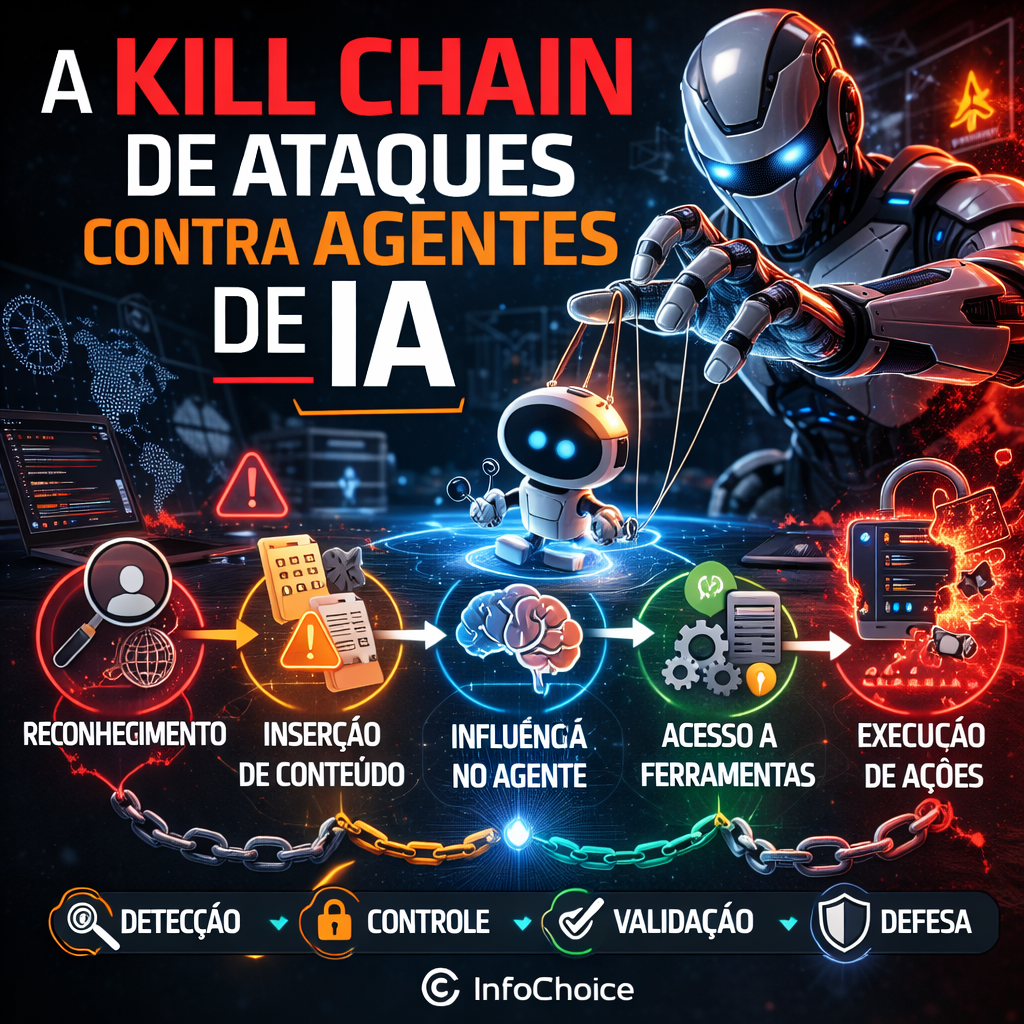

A kill chain de ataques contra agentes de IA

Ataques contra agentes de inteligência artificial raramente acontecem de forma isolada. Em muitos casos, eles evoluem em múltiplas etapas — desde o reconhecimento inicial até a execução de ações dentro de sistemas corporativos. Neste artigo exploramos a kill chain de ataques contra agentes de IA e como organizações podem interromper essas sequências.

-

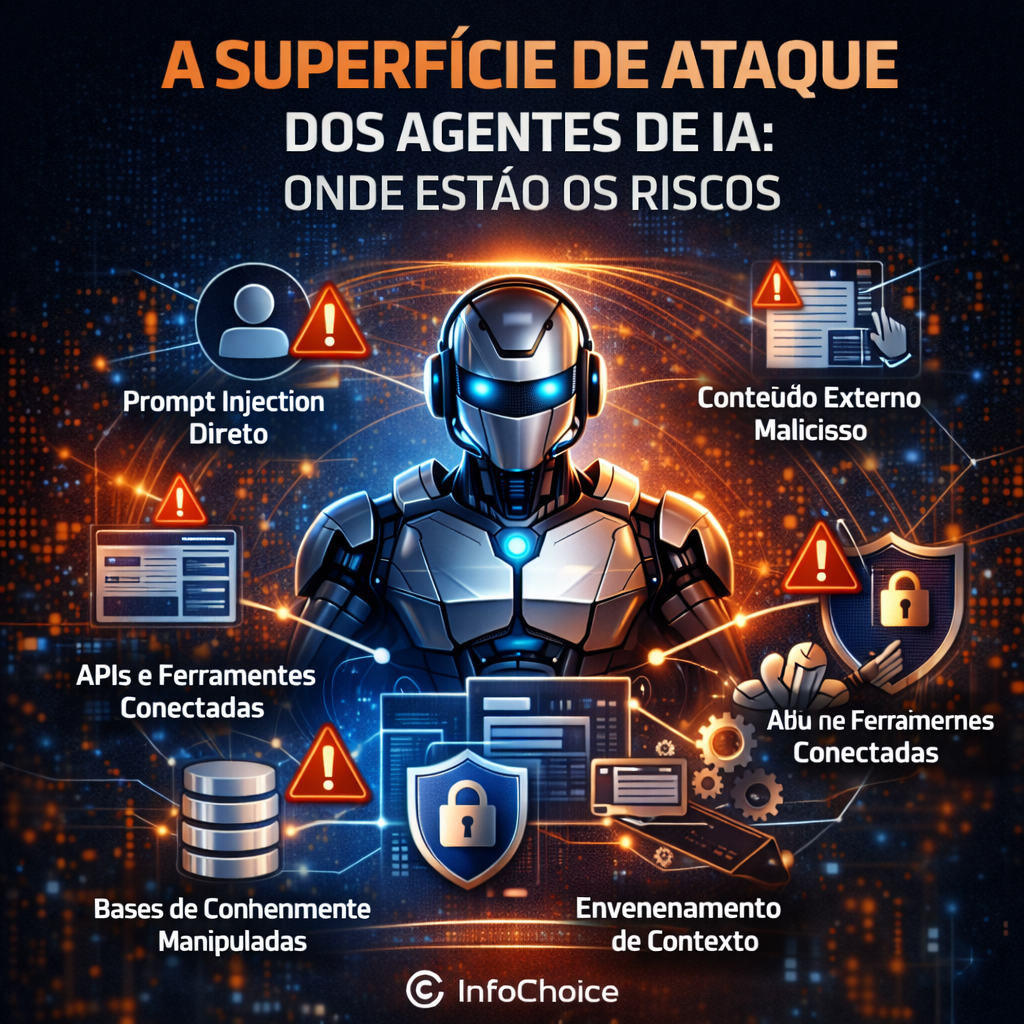

A superfície de ataque dos agentes de IA: onde estão os riscos

À medida que agentes de inteligência artificial passam a interagir com usuários, APIs, bases de conhecimento e sistemas corporativos, a superfície de ataque dessas arquiteturas se expande significativamente. Neste artigo analisamos onde estão os principais pontos de exposição e como esses sistemas podem ser explorados.

-

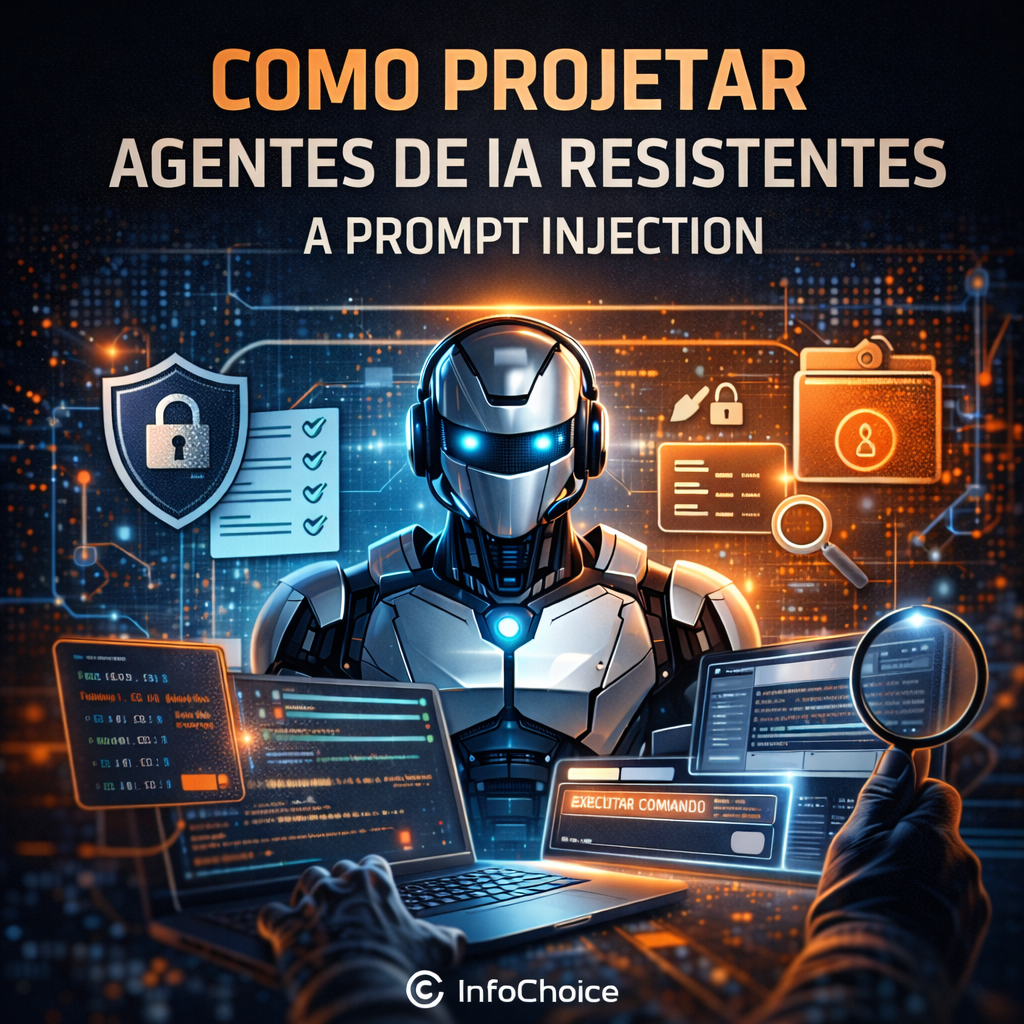

Como projetar agentes de IA resistentes a prompt injection

À medida que agentes de inteligência artificial passam a acessar dados, executar tarefas e interagir com sistemas corporativos, a segurança desses sistemas torna-se essencial. Neste artigo, exploramos princípios arquiteturais que ajudam a projetar agentes de IA mais resistentes a ataques de prompt injection.

-

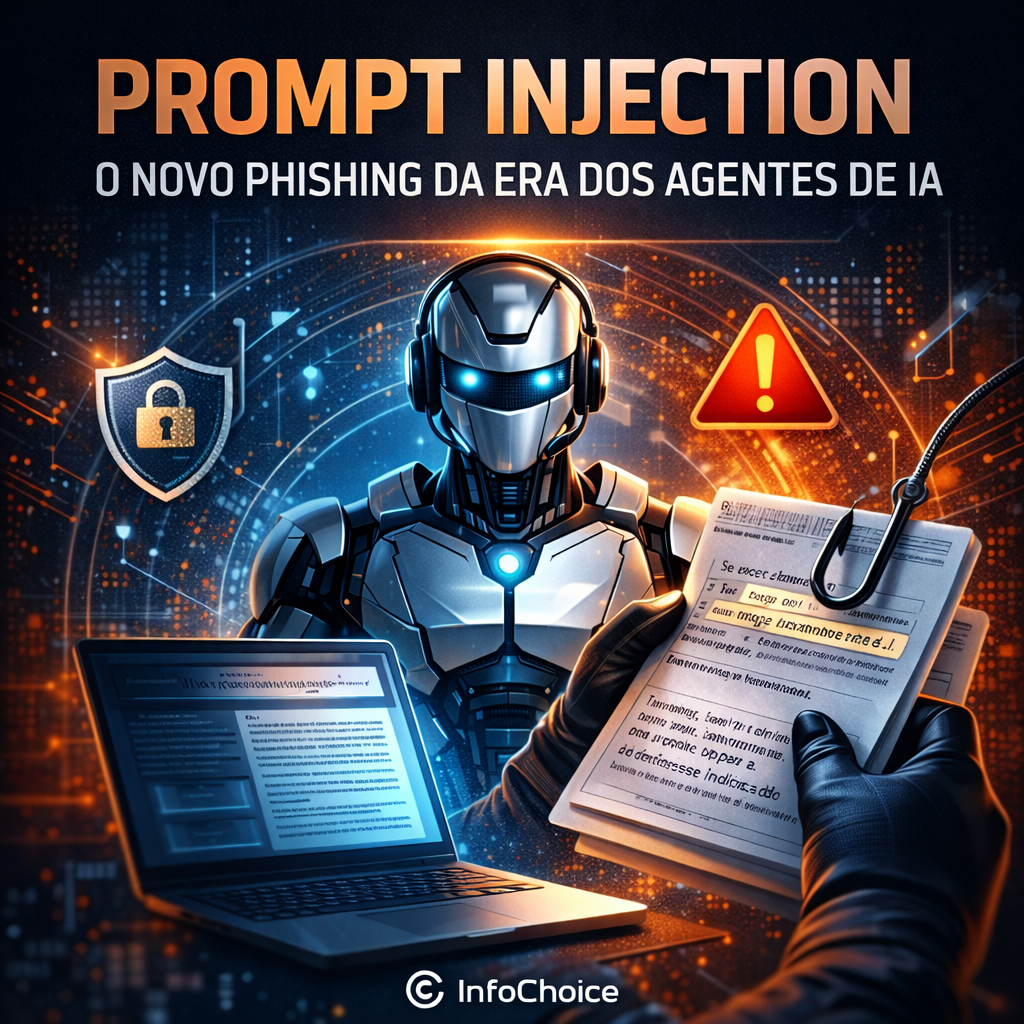

Prompt Injection: o novo phishing da era dos agentes de IA

O prompt injection está emergindo como uma das principais ameaças para sistemas baseados em inteligência artificial. Neste artigo da série sobre segurança de agentes de IA, exploramos como esses ataques funcionam, por que eles se assemelham à engenharia social e quais riscos representam para empresas que estão adotando agentes inteligentes.

-

Segurança de Agentes de IA: riscos, arquitetura e governança na nova era da automação inteligente

A nova geração de sistemas baseados em agentes de inteligência artificial está transformando a automação digital — e criando novos desafios para a segurança da informação. Nesta série especial da InfoChoice, exploramos os riscos emergentes, os modelos de ataque e as arquiteturas de defesa necessárias para proteger agentes de IA em ambientes corporativos.