Série Especial InfoChoice

A inteligência artificial generativa está entrando em uma nova fase. Depois da popularização dos copilotos e assistentes baseados em grandes modelos de linguagem, o próximo passo já começou a se consolidar: agentes de IA capazes de executar tarefas, interagir com sistemas e tomar decisões operacionais.

Esses agentes podem analisar documentos, navegar na web, interagir com APIs corporativas, automatizar fluxos de trabalho e até coordenar múltiplos sistemas de software. Em outras palavras, deixam de ser apenas ferramentas de consulta para se tornarem atores ativos dentro das arquiteturas digitais das organizações.

Mas essa evolução traz uma nova pergunta para líderes de tecnologia, segurança e inovação:

Como proteger sistemas onde a inteligência artificial não apenas responde perguntas, mas também executa ações no mundo real?

Essa questão está no centro de uma nova área emergente da cibersegurança: segurança de agentes de IA.

Nos últimos anos, pesquisadores e organizações de tecnologia começaram a observar um novo tipo de risco: ataques que manipulam o comportamento de modelos de linguagem por meio de instruções maliciosas inseridas em conteúdo aparentemente legítimo. Esse fenômeno ficou conhecido como prompt injection — um tipo de ataque que, em muitos aspectos, se assemelha à engenharia social usada contra pessoas.

Conforme os agentes de IA passam a ler e-mails, analisar documentos, navegar em páginas web e executar tarefas automatizadas, esse tipo de manipulação pode levar a consequências concretas, como exposição de dados sensíveis, execução de comandos indesejados ou interferência em processos corporativos.

Diante desse cenário, compreender os riscos e as estratégias de defesa para agentes de IA tornou-se uma prioridade para arquitetos de software, engenheiros de segurança, líderes de tecnologia e executivos responsáveis pela governança digital.

É justamente esse o objetivo desta nova série especial da InfoChoice.

Uma série para entender e proteger a próxima geração de sistemas inteligentes

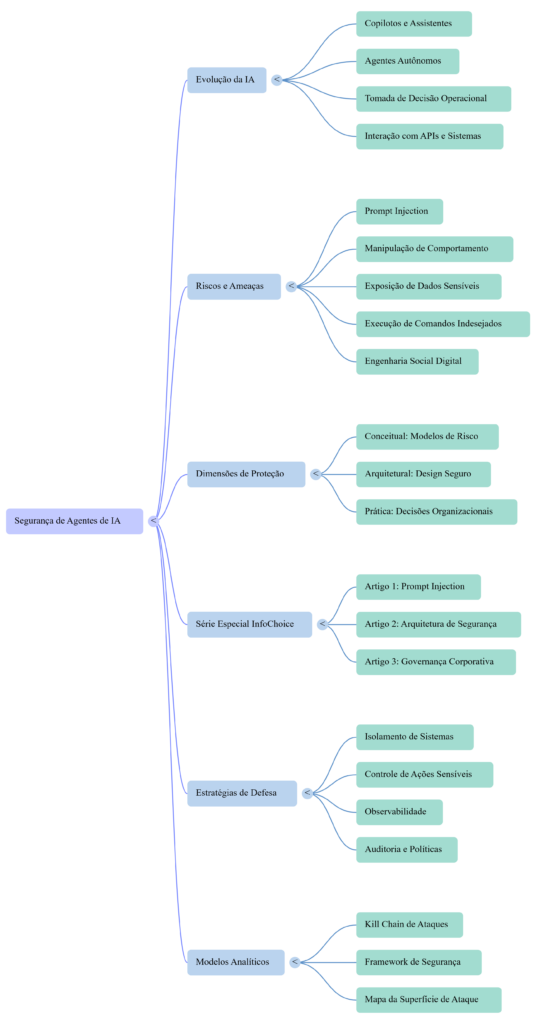

A série “Segurança de Agentes de IA” foi concebida para explorar de forma estruturada e aprofundada os desafios de segurança que surgem quando modelos de linguagem passam a atuar como agentes dentro de ambientes corporativos.

Nosso objetivo é oferecer à audiência da InfoChoice uma visão que combine três dimensões fundamentais:

- Conceitual — explicando os novos modelos de risco associados a agentes de IA.

- Arquitetural — mostrando como projetar sistemas mais seguros.

- Prática — traduzindo conceitos técnicos em decisões que podem ser aplicadas em organizações.

Cada artigo da série será estruturado para conectar pesquisa, arquitetura tecnológica e aplicações reais.

Conteúdo multimodal para aprofundar a análise

Para tornar a experiência mais rica e didática, cada artigo da série será acompanhado por diferentes formatos de conteúdo desenvolvidos pela InfoChoice:

Infográficos conceituais

Modelos visuais que explicam arquiteturas, superfícies de ataque e mecanismos de defesa para agentes de IA.

Mapas mentais

Estruturas que organizam os principais conceitos apresentados em cada artigo, facilitando a compreensão e a retenção das ideias centrais.

Podcasts com análises imersivas

Conversas aprofundadas explorando os temas discutidos nos textos, conectando implicações técnicas, estratégicas e de mercado.

Essa abordagem multimodal permite que a série funcione tanto como material de reflexão estratégica quanto como referência prática para profissionais de tecnologia e segurança.

O que você encontrará ao longo da série

A série será organizada em 6 artigos principais e um bônus:

Artigo 1 — Prompt Injection: o novo phishing da era dos agentes de IA

Uma introdução ao principal vetor de ataque emergente contra modelos de linguagem e agentes inteligentes.

Artigo 2 — Como Projetar Agentes de IA Resistentes a Prompt Injection

Um guia conceitual e arquitetural para projetar agentes mais seguros, com base em princípios como isolamento, controle de ações sensíveis e observabilidade.

Artigo 3 — A Superfície de Ataque dos Agentes de IA: Onde Estão os Riscos

Uma análise sobre como empresas podem estruturar políticas, auditoria e gestão de risco para o uso corporativo de agentes autônomos.

Artigo 4 — A Kill Chain de Ataques Contra Agentes de IA

Uma análise para compreender completamente esse problema: como os ataques realmente acontecem ao longo do tempo.

Artigo 5 – Lockdown Mode e Segurança em IA: o que a nova iniciativa da OpenAI revela sobre o futuro corporativo

O Lockdown Mode permite restringir interações externas, reduzindo a superfície de exposição e protegendo dados estratégicos contra tentativas de extração indevida.

Artigo 6 – Cibersegurança em 2026: IA, Guerra Digital e a Nova Era das Ameaças Cibernéticas

Artigo Bônus – Governança Autônoma: como agentes de IA estão redefinindo segurança e compliance

Uma nova fronteira da segurança digital

Durante décadas, a segurança da informação concentrou-se em proteger redes, sistemas e aplicações. Com o avanço da inteligência artificial generativa, surge um novo desafio: proteger sistemas capazes de interpretar linguagem, raciocinar sobre informações e executar ações no ambiente digital.

Compreender essa transformação é essencial para qualquer organização que esteja explorando automação inteligente, copilotos corporativos ou arquiteturas baseadas em agentes.

É com esse objetivo que iniciamos esta série.

No próximo artigo, começaremos examinando o fenômeno que está no centro desse novo cenário: o prompt injection — frequentemente descrito como o equivalente da engenharia social para modelos de linguagem e agentes de IA.

Podcast e Análise Imersiva

Infográfico

Mapa Mental

ESTRUTURA DA SÉRIE ESPECIAL

Segurança da Informação – AGENTES DE IA

Segurança de agentes de IA na era da inteligência artificial

2️⃣ Artigo 1

Prompt Injection: o novo phishing da era da IA

3️⃣ Artigo 2

Como projetar agentes de IA resistentes a prompt injection

4️⃣ Artigo 3

A superfície de ataque de agentes de IA

5️⃣ Artigo 4

Kill chain de ataques contra agentes de IA

Lockdown Mode e Segurança em IA: o que a nova iniciativa da OpenAI revela sobre o futuro corporativo

Cibersegurança em 2026: IA, Guerra Digital e a Nova Era das Ameaças Cibernéticas

Artigo Bônus

Governança Autônoma: como agentes de IA estão redefinindo segurança e compliance

Explore também outras Séries Especiais da InfoChoice

A InfoChoice mantém uma biblioteca de análises estratégicas sobre tecnologia, inovação e transformação digital.

Conheça também nossas outras coleções:

Deixe um comentário