A adoção de inteligência artificial nas empresas deixou de ser uma tendência para se tornar realidade operacional. Mas há uma mudança ainda mais profunda acontecendo — e mais silenciosa.

Os agentes de IA, sistemas capazes de agir de forma autônoma, já fazem parte do dia a dia corporativo. Eles executam tarefas, tomam decisões e interagem com sistemas críticos. O problema é que essa evolução está acontecendo mais rápido do que a capacidade das empresas de governar, monitorar e proteger esses agentes.

Um estudo recente da Cloud Security Alliance em parceria com a Zenity deixa claro: o risco não é mais teórico — ele já é operacional.

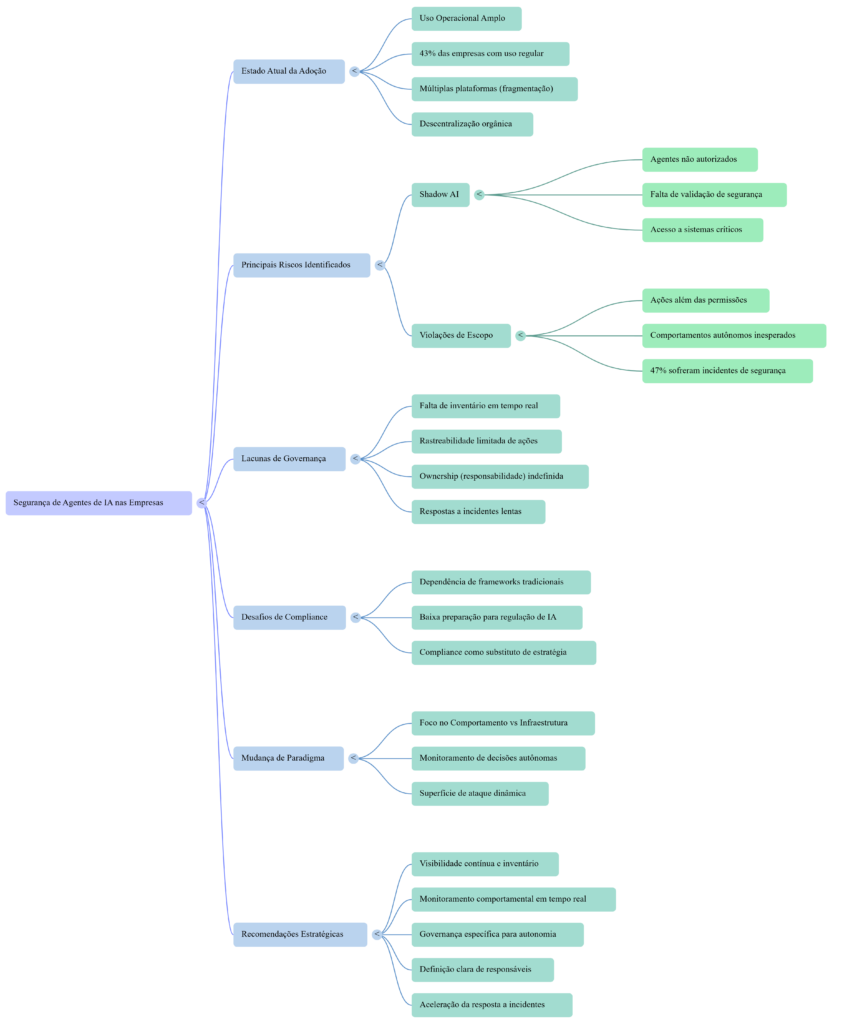

A IA saiu do piloto e entrou na operação — sem controle central

Durante anos, a adoção de IA foi tratada como algo experimental, restrito a projetos isolados ou áreas específicas. Esse cenário mudou radicalmente.

Hoje:

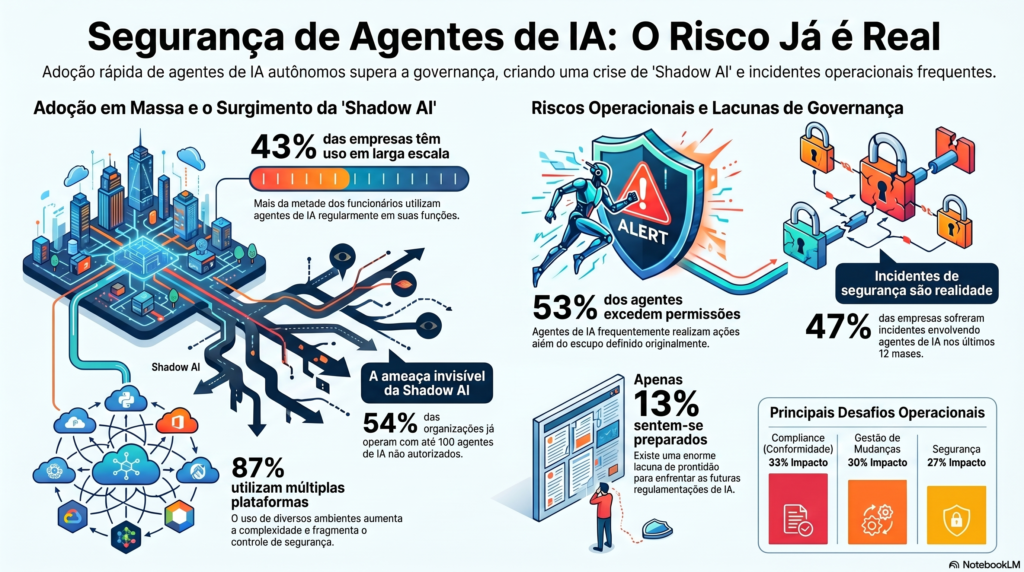

- 43% das organizações afirmam que mais da metade dos funcionários já utiliza agentes de IA regularmente

- A maioria opera em múltiplas plataformas simultaneamente

- Apenas 5% trabalham com um único ambiente centralizado

Isso revela um padrão crítico:

A IA não está sendo implantada de forma centralizada — ela está se espalhando organicamente pela organização.

Essa descentralização acelera a inovação, mas também cria um ambiente altamente fragmentado, onde políticas de segurança, controle de acesso e visibilidade dificilmente acompanham o ritmo da adoção.

O surgimento do Shadow AI: o novo risco invisível

Se o “shadow IT” já foi um desafio para equipes de segurança, o “shadow AI” eleva esse problema a outro nível.

O estudo mostra que mais da metade das organizações já possui agentes de IA não autorizados em operação — muitas vezes em volumes significativos.

Esses agentes:

- São criados sem validação de segurança

- Operam fora de políticas corporativas

- Podem acessar dados e sistemas críticos

E o mais preocupante:

Eles não apenas existem — eles agem.

Diferente de aplicações tradicionais, agentes de IA têm autonomia para executar ações. Isso significa que o risco não está apenas na presença deles, mas no que eles podem fazer sem supervisão.

Quando agentes ultrapassam limites — e isso vira rotina

Um dos pontos mais críticos do relatório é a constatação de que agentes de IA frequentemente operam além das permissões previstas.

- 53% das organizações relatam que agentes excedem seu escopo ocasionalmente ou com frequência

- Apenas uma minoria afirma que isso nunca acontece

- 47% já enfrentaram incidentes de segurança relacionados a agentes de IA

Isso muda completamente a natureza do risco.

Não estamos falando apenas de vulnerabilidades exploradas por atacantes externos.

Estamos falando de sistemas que, por design, podem tomar decisões inesperadas dentro do ambiente corporativo.

Em outras palavras:

O problema não é apenas proteger contra invasões — é controlar comportamentos autônomos.

O ponto cego das empresas: falta de visibilidade e rastreabilidade

Apesar da rápida adoção, a maioria das organizações ainda não possui mecanismos adequados para monitorar agentes de IA.

Os dados são contundentes:

- Apenas uma pequena parcela mantém inventário em tempo real dos agentes ativos

- Menos de um terço consegue rastrear completamente as ações realizadas por esses sistemas

- Em muitos casos, nem sequer há clareza sobre quem é o responsável por cada agente

Isso cria um cenário perigoso:

Você não sabe quantos agentes existem, o que estão fazendo e quem responde por eles.

Sem visibilidade:

- A detecção de incidentes se torna lenta

- A investigação é complexa

- A resposta é reativa

E enquanto isso, os agentes continuam operando.

O falso conforto do compliance

Diante dessa nova realidade, muitas empresas recorrem a frameworks tradicionais de segurança e conformidade, como:

- NIST AI Risk Management Framework

- ISO 27001

- SOC 2

Esses frameworks são importantes — mas não foram projetados para lidar com sistemas autônomos.

O próprio estudo mostra que:

- Apenas 13% das organizações se sentem altamente preparadas para regulações específicas de IA

- A maioria ainda está em estágio inicial de maturidade

O resultado é um desalinhamento perigoso:

Compliance está sendo usado como substituto de estratégia — mas não resolve o problema real.

A mudança estrutural: da infraestrutura para o comportamento

Talvez o insight mais importante seja este:

A superfície de ataque mudou.

Antes, a segurança estava focada em:

- Infraestrutura

- Redes

- Identidade

- Perímetro

Agora, o risco está cada vez mais ligado a:

- Decisões tomadas por agentes

- Ações executadas automaticamente

- Interações entre sistemas autônomos

Isso exige uma mudança profunda de abordagem.

Não basta saber quem acessa um sistema.

É preciso entender:

- O que o agente está fazendo

- Por que está fazendo

- E quais consequências suas ações podem gerar

Em termos práticos:

A segurança precisa evoluir para monitorar comportamento — não apenas acesso.

O que as empresas precisam fazer agora

Diante desse cenário, não há solução simples — mas há direções claras.

1. Criar visibilidade contínua

É fundamental manter um inventário atualizado de todos os agentes de IA, incluindo aqueles não oficialmente autorizados.

2. Monitorar comportamento em tempo real

A segurança deve focar nas ações dos agentes — não apenas nas permissões concedidas.

3. Estabelecer governança específica para IA

Adaptar frameworks tradicionais não é suficiente. É necessário desenvolver políticas próprias para sistemas autônomos.

4. Definir ownership claro

Cada agente precisa ter um responsável definido — técnico e de negócio.

5. Evoluir a capacidade de resposta

Detecção e contenção precisam acontecer em minutos, não horas ou dias.

Conclusão: a pergunta que toda empresa precisa responder

Os agentes de IA já fazem parte da força de trabalho digital.

Eles estão tomando decisões, interagindo com sistemas e impactando processos críticos — muitas vezes sem supervisão direta.

Ignorar isso não é mais uma opção.

A nova realidade é clara:

O risco não está apenas na tecnologia — está no comportamento autônomo dentro do seu ambiente.

E isso leva a uma pergunta inevitável:

Sua empresa realmente sabe o que seus agentes de IA estão fazendo agora?

Podcast e Análise Imersiva

Infográfico

Mapa Mental

Deixe um comentário