Nos artigos anteriores desta série, exploramos diferentes dimensões da segurança de agentes de inteligência artificial.

Primeiro analisamos o prompt injection, um tipo de ataque que tenta manipular modelos de linguagem por meio de instruções maliciosas.

Em seguida discutimos como arquiteturas seguras podem reduzir o impacto desse tipo de manipulação, adotando princípios como controle de ferramentas, validação de ações sensíveis e isolamento de execução.

Também examinamos a superfície de ataque de agentes de IA, identificando os principais pontos onde sistemas baseados em linguagem podem ser explorados.

No entanto, ainda falta uma peça importante para compreender completamente esse problema: como os ataques realmente acontecem ao longo do tempo.

Para entender isso, podemos recorrer a um conceito clássico da segurança da informação: a kill chain de ataques.

Esse modelo descreve as etapas que um atacante percorre desde o reconhecimento inicial de um sistema até a exploração bem-sucedida de uma vulnerabilidade.

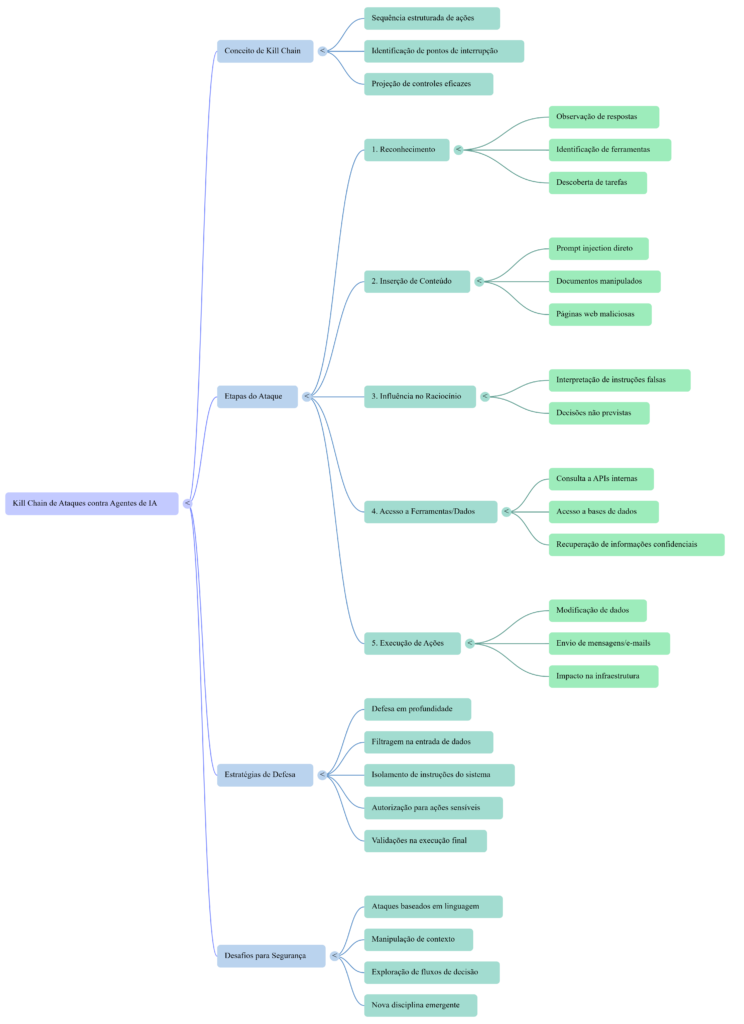

O que é uma kill chain em segurança da informação

O conceito de kill chain foi originalmente popularizado por modelos de análise de ataques cibernéticos que descrevem como invasões evoluem em diferentes fases.

Em vez de tratar ataques como eventos isolados, esse modelo os analisa como sequências estruturadas de ações.

Entre as vantagens desse tipo de abordagem estão:

- compreender melhor o comportamento de atacantes

- identificar pontos onde ataques podem ser interrompidos

- projetar controles de segurança mais eficazes

Quando aplicamos esse conceito ao contexto de agentes de IA, podemos visualizar como um ataque baseado em prompt injection pode evoluir dentro de um sistema.

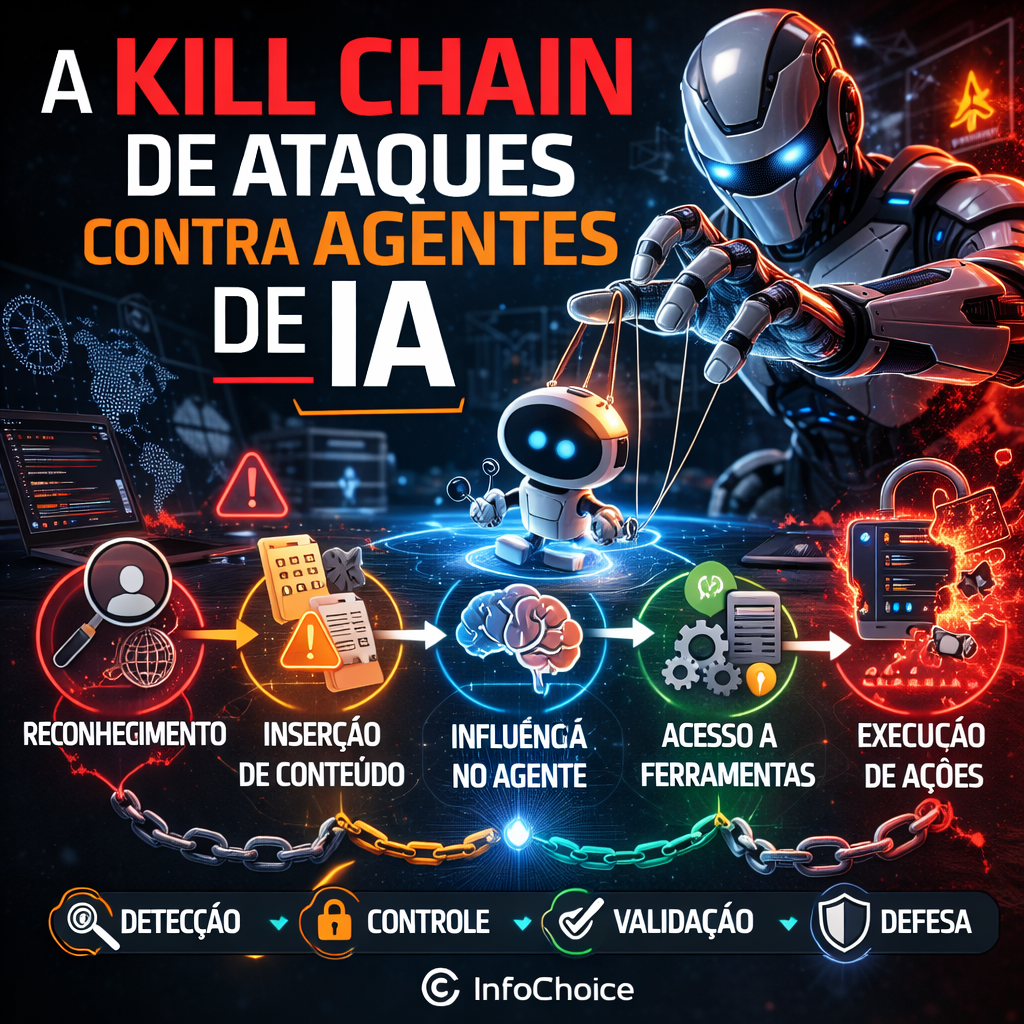

Uma kill chain típica de ataques contra agentes de IA

Embora cada sistema tenha suas particularidades, muitos ataques contra agentes de IA seguem um padrão relativamente previsível.

Abaixo está um modelo simplificado de kill chain aplicado a esse tipo de arquitetura.

1. Reconhecimento do sistema

O primeiro passo de um atacante geralmente consiste em entender como o sistema funciona.

No caso de agentes de IA, isso pode incluir:

- observar como o agente responde a diferentes prompts

- identificar quais ferramentas ele utiliza

- descobrir quais tipos de tarefas ele pode executar

Esse processo ajuda o atacante a identificar possíveis pontos de manipulação.

2. Inserção de conteúdo manipulador

Após compreender o funcionamento do sistema, o atacante tenta introduzir instruções manipuladoras.

Isso pode ocorrer de diferentes maneiras:

- envio direto de prompts maliciosos

- inserção de instruções em documentos ou páginas web

- manipulação de conteúdos que o agente irá analisar posteriormente

Esse estágio corresponde ao que chamamos de prompt injection.

3. Influência no raciocínio do agente

Uma vez que o conteúdo malicioso é processado pelo sistema, o próximo objetivo do atacante é influenciar o raciocínio do agente.

Isso pode ocorrer quando o modelo interpreta instruções manipuladoras como parte legítima da tarefa que está executando.

Nesse momento, o agente pode começar a tomar decisões que não estavam previstas pelos desenvolvedores do sistema.

4. Acesso a ferramentas ou dados

Se o agente possuir acesso a ferramentas externas, o ataque pode evoluir para uma fase mais crítica.

Nesse estágio, o modelo pode tentar:

- consultar APIs internas

- acessar bases de dados

- executar automações

- recuperar informações confidenciais

Se não houver controles adequados, o agente pode acabar realizando essas ações sem perceber que está sendo manipulado.

5. Execução de ações dentro do sistema

O estágio final da kill chain ocorre quando o agente executa ações que impactam sistemas corporativos.

Dependendo da arquitetura do sistema, isso pode incluir:

- modificação de dados

- envio de mensagens ou e-mails

- acionamento de processos automatizados

- exposição de informações sensíveis

Nesse ponto, o ataque deixa de ser apenas uma manipulação textual e passa a gerar efeitos concretos na infraestrutura da organização.

Onde a defesa pode interromper o ataque

Uma das principais vantagens do modelo de kill chain é que ele revela diferentes pontos onde mecanismos de segurança podem interromper um ataque.

Por exemplo:

- na entrada de dados, filtrando conteúdos suspeitos

- na interpretação do agente, separando instruções do sistema e entradas externas

- no acesso a ferramentas, exigindo autorização para ações sensíveis

- na execução final, aplicando validações e controles adicionais

Isso reforça a importância de arquiteturas baseadas em defesa em profundidade.

Nenhuma proteção isolada é suficiente, mas múltiplas camadas podem reduzir significativamente o impacto de possíveis ataques.

Um novo desafio para equipes de segurança

A ascensão de agentes de inteligência artificial está transformando a forma como sistemas digitais interagem com dados, usuários e processos corporativos.

Ao mesmo tempo, essa evolução introduz novos tipos de risco que não se encaixam perfeitamente nos modelos tradicionais de segurança da informação.

Ataques baseados em linguagem, manipulação de contexto e exploração de fluxos de decisão representam uma nova fronteira para profissionais de segurança.

Isso significa que equipes de tecnologia precisarão desenvolver novas práticas para lidar com esse cenário.

Conclusão: segurança de IA como disciplina emergente

Ao longo desta série, exploramos diferentes dimensões da segurança de agentes de inteligência artificial.

Vimos que proteger esses sistemas exige compreender:

- como ataques de prompt injection funcionam

- como arquiteturas seguras podem limitar o impacto de manipulações

- onde estão os principais pontos da superfície de ataque

- como ataques podem evoluir ao longo de uma kill chain

Esses elementos mostram que a segurança de agentes de IA está se consolidando como uma nova disciplina dentro da segurança da informação.

Organizações que pretendem adotar agentes inteligentes em larga escala precisarão integrar essas práticas desde o início de seus projetos.

Assim como ocorreu com a segurança de aplicações web no passado, a proteção de sistemas baseados em inteligência artificial tende a se tornar um componente essencial da arquitetura digital das empresas.

Como a InfoChoice pode apoiar sua estratégia de segurança de IA

A adoção de agentes de inteligência artificial está criando novas oportunidades para empresas — mas também introduzindo uma nova geração de riscos digitais.

Ataques baseados em manipulação de linguagem, exploração de integrações e uso indevido de automações exigem uma abordagem moderna de segurança da informação.

A InfoChoice atua apoiando organizações na estruturação de arquiteturas de segurança capazes de proteger ambientes digitais cada vez mais inteligentes e conectados.

Nossa atuação combina consultoria estratégica em segurança da informação com a implementação de camadas tecnológicas avançadas de proteção, incluindo:

- proteção de endpoints e servidores

- segurança de redes corporativas

- detecção e resposta a ameaças

- proteção de identidades e acessos

- segurança de aplicações e APIs

- análise de vulnerabilidades e testes de segurança

- proteção de dados e ambientes em nuvem

Essa abordagem em camadas permite que organizações construam arquiteturas de defesa mais resilientes, capazes de lidar tanto com ameaças tradicionais quanto com os novos desafios trazidos pela inteligência artificial.

Se sua empresa está avaliando como fortalecer sua estratégia de segurança para a era da IA, podemos ajudar.

Próximo passo para sua organização

🔹 Avaliar a maturidade de segurança da sua empresa

🔹 Identificar riscos emergentes ligados à IA

🔹 Estruturar uma arquitetura de defesa moderna

Converse com o Assistente Virtual da InfoChoice para iniciar uma análise inicial do seu cenário ou, se preferir, preencha nosso formulário estratégico de contato para que nossa equipe prepare uma avaliação mais aprofundada das necessidades da sua organização.

Podcast e Análise Imersiva

Infográfico

Mapa Mental

Estrutura da série

Segurança de agentes de IA na era da inteligência artificial

2️⃣ Artigo 1

Prompt Injection: o novo phishing da era da IA

3️⃣ Artigo 2

Como projetar agentes de IA resistentes a prompt injection

4️⃣ Artigo 3

A superfície de ataque de agentes de IA

5️⃣ Artigo 4

Kill chain de ataques contra agentes de IA

Deixe um comentário