Nos dois primeiros artigos desta série, exploramos dois aspectos fundamentais da segurança de agentes de inteligência artificial.

Primeiro, analisamos o prompt injection, um tipo de ataque que tenta manipular modelos de linguagem por meio de instruções maliciosas inseridas em texto ou conteúdo analisado pelo sistema.

Em seguida, discutimos como arquiteturas seguras podem reduzir o impacto desse tipo de manipulação, adotando princípios como controle de ferramentas, validação de ações sensíveis e isolamento de execução.

No entanto, para proteger adequadamente sistemas baseados em agentes de IA, é necessário dar um passo adicional: entender onde os ataques podem ocorrer.

Assim como aplicações tradicionais possuem superfícies de ataque bem definidas — como interfaces web, APIs e bancos de dados — sistemas baseados em agentes também apresentam diferentes pontos de exposição.

Compreender essa superfície de ataque é essencial para qualquer organização que esteja integrando agentes de inteligência artificial em seus processos.

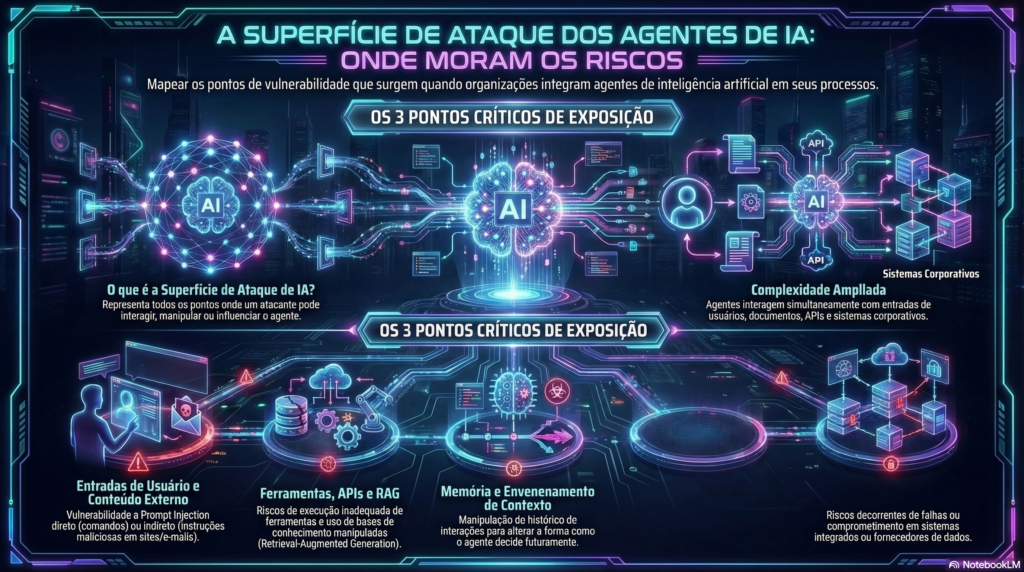

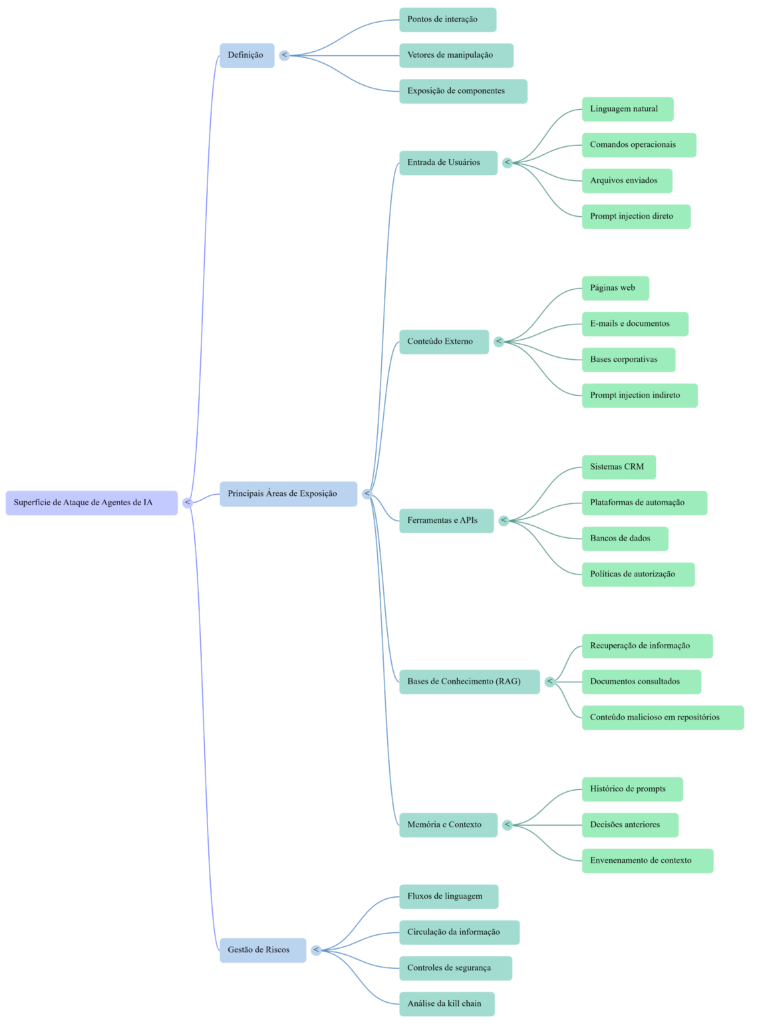

O que é a superfície de ataque de um agente de IA

A superfície de ataque de um sistema representa todos os pontos onde um atacante pode tentar interagir com ele ou manipulá-lo.

No caso de agentes de IA, essa superfície tende a ser mais ampla do que em aplicações tradicionais.

Isso acontece porque agentes baseados em modelos de linguagem normalmente interagem com diferentes componentes ao mesmo tempo, como:

- entradas de usuários

- documentos externos

- bases de conhecimento

- ferramentas e APIs

- sistemas corporativos

Cada uma dessas interações pode se tornar um possível vetor de ataque.

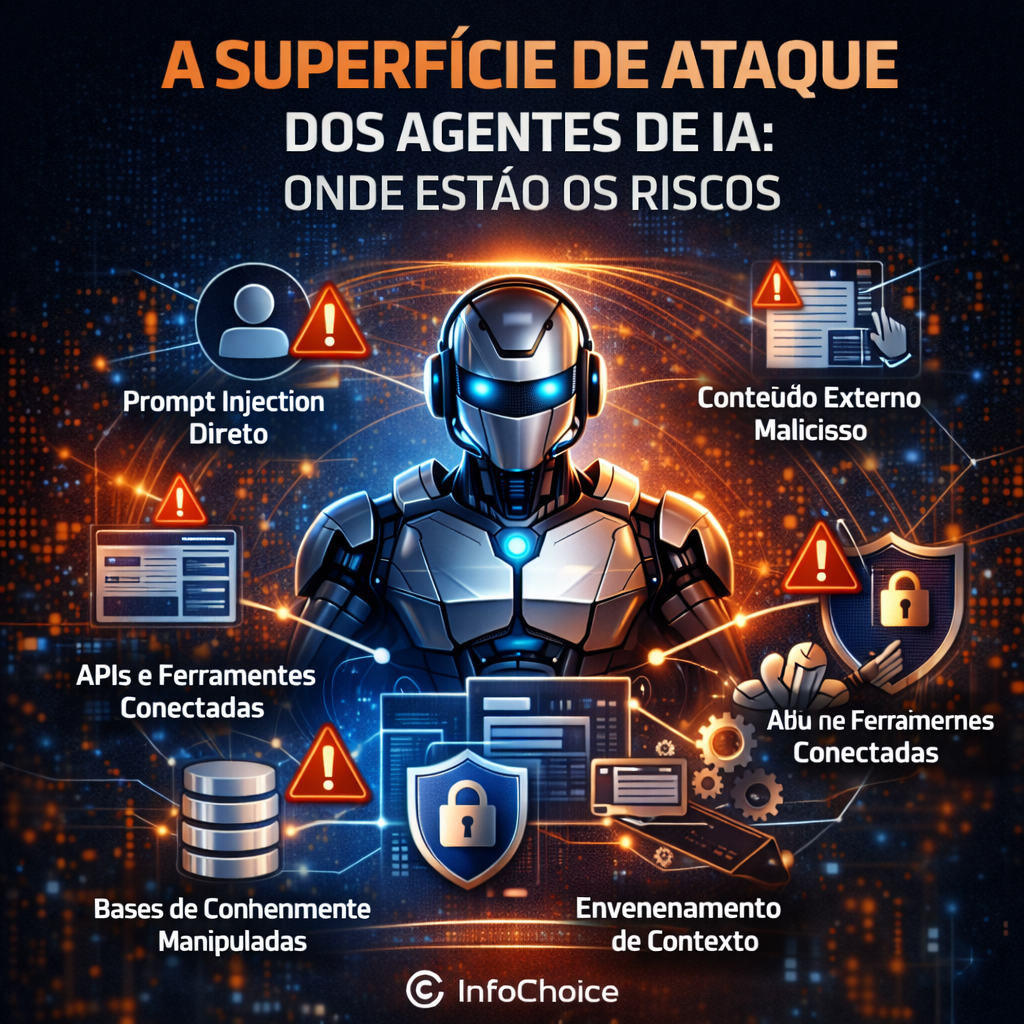

As principais áreas da superfície de ataque de agentes de IA

Embora a arquitetura de cada sistema possa variar, a maioria dos agentes de IA apresenta alguns pontos de exposição recorrentes.

Compreender essas áreas ajuda equipes de tecnologia a identificar onde controles de segurança devem ser aplicados.

1. Entrada de usuários

O ponto mais evidente de interação com um agente de IA é a interface onde usuários fornecem instruções.

Essas entradas podem incluir:

- perguntas em linguagem natural

- comandos operacionais

- arquivos enviados ao sistema

Esse tipo de interface é um dos principais pontos onde ataques de prompt injection direto podem ocorrer.

Um usuário mal-intencionado pode tentar inserir instruções projetadas para manipular o comportamento do modelo.

2. Conteúdo externo analisado pelo agente

Muitos agentes de IA analisam informações vindas de fontes externas, como:

- páginas web

- e-mails

- documentos

- bases de conhecimento corporativas

Esse cenário abre espaço para um tipo de ataque conhecido como prompt injection indireto.

Nesse caso, o atacante não interage diretamente com o agente, mas insere instruções maliciosas em conteúdos que o sistema irá processar posteriormente.

3. Ferramentas e APIs conectadas ao agente

Uma das características mais poderosas dos agentes de IA é sua capacidade de interagir com ferramentas externas.

Essas ferramentas podem incluir:

- sistemas de CRM

- plataformas de automação

- bancos de dados

- APIs corporativas

Se o agente for manipulado por um prompt malicioso, ele pode tentar usar essas ferramentas de forma inadequada.

Por essa razão, o acesso a ferramentas deve ser sempre controlado por políticas claras de autorização.

4. Bases de conhecimento e sistemas de RAG

Muitos agentes utilizam arquiteturas baseadas em recuperação de informação, frequentemente chamadas de RAG (Retrieval-Augmented Generation).

Nesse modelo, o agente consulta documentos ou bases de conhecimento antes de gerar uma resposta.

Se essas bases contiverem conteúdo malicioso ou manipulado, o agente pode acabar utilizando essas informações como parte de seu processo de decisão.

Isso transforma repositórios de conhecimento em um possível vetor de ataque.

5. Memória e contexto do agente

Alguns sistemas de agentes mantêm memória de interações anteriores para melhorar a continuidade das conversas.

Essa memória pode incluir:

- histórico de prompts

- decisões anteriores

- informações contextuais sobre o usuário

Se um atacante conseguir influenciar esse contexto, ele pode alterar a forma como o agente interpreta interações futuras.

Esse tipo de manipulação é conhecido como envenenamento de contexto.

Um novo mapa de riscos para sistemas baseados em IA

Quando observamos todos esses elementos em conjunto, fica claro que agentes de IA possuem uma superfície de ataque bastante complexa.

Ela envolve não apenas software tradicional, mas também:

- fluxos de linguagem

- conteúdo textual

- sistemas de recuperação de informação

- interações entre humanos e máquinas

Esse cenário exige que organizações desenvolvam novas práticas de análise de risco.

Em vez de avaliar apenas vulnerabilidades técnicas, também será necessário considerar como a informação circula dentro do sistema.

Por que esse mapa é importante para as empresas

Empresas que estão começando a integrar agentes de IA em seus processos frequentemente subestimam esse tipo de risco.

Isso acontece porque muitos desses sistemas começam como projetos experimentais ou assistentes internos.

No entanto, à medida que esses agentes passam a:

- acessar dados corporativos

- executar tarefas operacionais

- interagir com clientes

o impacto potencial de um ataque aumenta significativamente.

Compreender a superfície de ataque permite que equipes de tecnologia adotem controles de segurança antes que problemas ocorram.

O próximo passo: entender a kill chain de ataques contra agentes de IA

Mapear a superfície de ataque é um passo essencial, mas ainda não revela completamente como os ataques acontecem.

Para entender isso, é útil observar o problema sob outra perspectiva: a sequência de etapas que um atacante percorre ao explorar um sistema.

No próximo artigo desta série, vamos explorar o conceito de kill chain de ataques contra agentes de IA.

Esse modelo ajuda a visualizar como ataques podem evoluir desde a inserção de um prompt malicioso até a execução de ações dentro de sistemas corporativos.

Compreender essa sequência é fundamental para projetar mecanismos de defesa realmente eficazes.

Podcast e Análise Imersiva

Infográfico

Mapa Mental

Deixe um comentário