🔥 A inteligência artificial deixou de ser ferramenta. Agora é poder.

Durante anos, a inteligência artificial foi tratada como um acelerador de produtividade — uma tecnologia capaz de otimizar processos, automatizar tarefas e gerar insights.

Mas esse ciclo terminou.

A nova geração de modelos avançados não apenas executa tarefas:

ela amplifica capacidades humanas em escala, incluindo aquelas relacionadas à segurança, análise de vulnerabilidades e engenharia de sistemas complexos.

E isso traz uma questão inevitável para o C-level:

Quem deve ter acesso à inteligência mais poderosa do mundo?

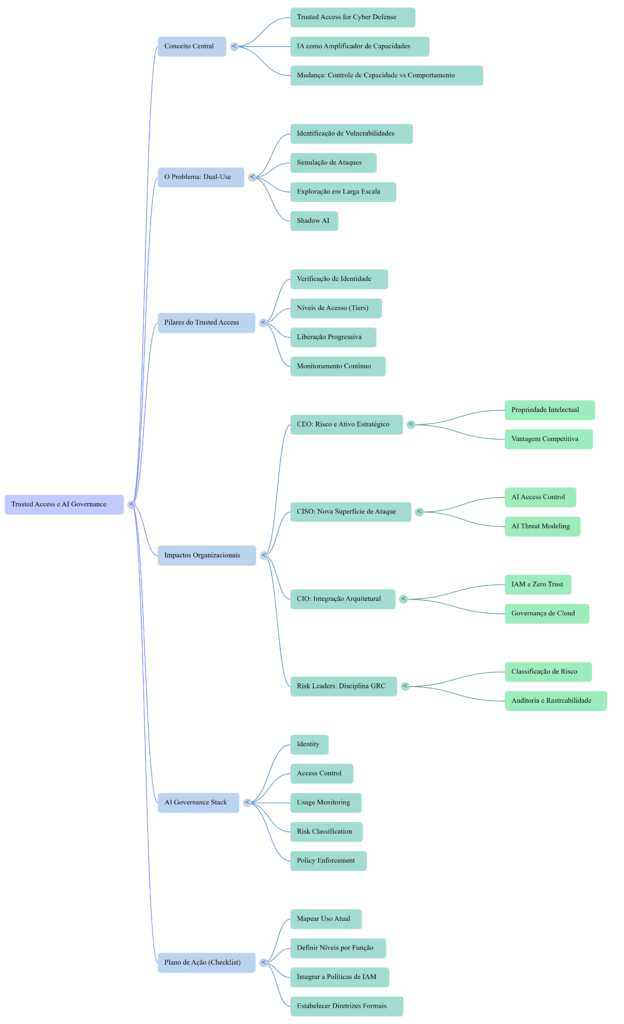

É nesse contexto que a OpenAI introduz um conceito que pode redefinir o futuro da governança digital: Trusted Access for Cyber Defense.

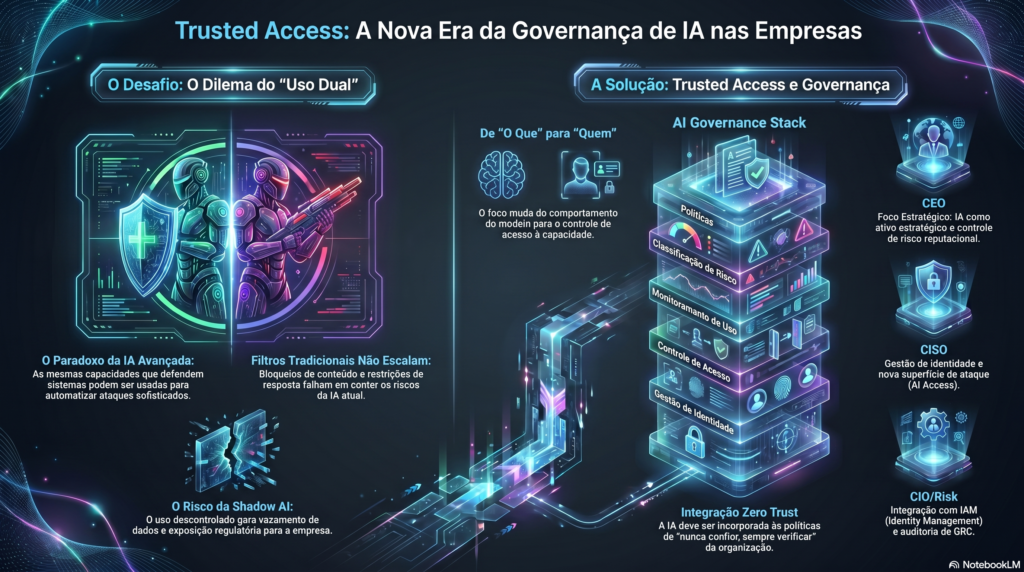

⚠️ O problema que ninguém resolveu: o dilema do “dual-use”

A inteligência artificial aplicada à cibersegurança carrega um paradoxo estrutural.

As mesmas capacidades que permitem:

- identificar vulnerabilidades críticas

- simular ataques sofisticados

- fortalecer defesas digitais

também podem ser utilizadas para:

- explorar falhas em larga escala

- automatizar ataques

- escalar operações maliciosas

Esse é o chamado dual-use problem — um desafio que não é novo, mas que se intensifica exponencialmente com IA avançada.

Modelos tradicionais de controle, baseados em:

- restrições de conteúdo

- bloqueios de resposta

- filtros de uso

simplesmente não escalam nesse novo cenário.

Para organizações, isso se traduz em riscos reais:

- uso indevido interno de IA

- exposição de capacidades sensíveis

- crescimento do fenômeno de Shadow AI

🔐 A virada de paradigma: de “o que a IA faz” para “quem pode usar”

A proposta da OpenAI marca uma mudança fundamental.

Até agora, o foco estava em limitar o comportamento do modelo.

Agora, o foco passa a ser controlar o acesso à capacidade.

O que muda na prática?

Surge um modelo baseado em confiança:

- Verificação de identidade de usuários e organizações

- Níveis de acesso (tiers) conforme perfil e necessidade

- Liberação progressiva de capacidades

- Monitoramento contínuo de uso

Esse movimento representa algo maior:

O nascimento de uma camada de identidade para inteligência artificial avançada.

🧠 Por que isso muda tudo (e para quem isso importa)

Essa transformação não é apenas tecnológica — ela é organizacional, estratégica e regulatória.

👨💼 Para o CEO: IA como risco e ativo estratégico

A inteligência artificial passa a ocupar o mesmo nível de criticidade de:

- dados sensíveis

- propriedade intelectual

- infraestrutura crítica

Sem governança adequada de acesso, IA se torna:

- vetor de risco reputacional

- exposição regulatória

- ameaça à vantagem competitiva

Mensagem-chave:

IA sem controle de acesso não é inovação — é risco corporativo.

🛡️ Para o CISO: uma nova superfície de ataque

A segurança deixa de ser apenas sobre sistemas.

Agora inclui:

- quem pode usar IA avançada

- como essa IA está sendo utilizada

Isso cria uma nova fronteira:

- AI Access Control

- AI Usage Monitoring

- AI Threat Modeling

Insight:

A segurança orientada por identidade agora se estende à inteligência artificial.

💻 Para o CIO: integração inevitável com a arquitetura corporativa

IA não pode mais ser tratada como ferramenta isolada.

Ela precisa estar integrada a:

- IAM (Identity & Access Management)

- políticas de Zero Trust

- governança de cloud e dados

Insight:

A inteligência artificial passa a fazer parte do core da arquitetura corporativa — e deve ser governada como tal.

📊 Para Risk Leaders: um novo domínio dentro do GRC

A IA introduz uma categoria de risco própria:

- risco de uso indevido

- risco de exposição de capacidade

- risco regulatório emergente

Isso exige:

- classificação de risco por tipo de uso de IA

- definição de políticas de acesso

- mecanismos de auditoria e rastreabilidade

Insight:

AI Governance deixa de ser tendência e se torna disciplina formal dentro de GRC.

🌐 A nova arquitetura de governança para IA

O modelo de Trusted Access se conecta diretamente com conceitos já consolidados — mas os eleva a um novo nível.

Estamos vendo a convergência entre:

- Zero Trust → nunca confiar, sempre verificar

- IAM → controle de identidade e acesso

- Least Privilege → acesso mínimo necessário

- Monitoramento contínuo → visibilidade total

🔷 AI Governance Stack (visão estratégica InfoChoice)

Para organizações, isso pode ser traduzido em um novo framework:

- Identity → quem está usando IA

- Access Control → quais capacidades estão liberadas

- Usage Monitoring → como a IA está sendo utilizada

- Risk Classification → qual o nível de risco do uso

- Policy Enforcement → quais regras estão sendo aplicadas

⚔️ A corrida já começou — e não é só por tecnologia

O movimento da OpenAI não acontece isoladamente.

Empresas como a Anthropic também estão avançando em modelos de controle e segurança.

O que está em jogo não é apenas:

- quem constrói a IA mais poderosa

Mas sim:

- quem consegue controlar o acesso a essa capacidade de forma segura e escalável

🚨 O risco de não agir agora

A maioria das organizações já está utilizando IA — muitas vezes sem perceber a extensão desse uso.

Sem uma abordagem estruturada, o cenário tende a evoluir para:

- adoção descontrolada

- ausência de políticas claras

- falta de visibilidade sobre uso

As consequências são diretas:

- vazamento de informações sensíveis

- uso indevido de capacidades avançadas

- aumento da exposição regulatória

🚀 O que as empresas devem fazer agora

A transição para esse novo modelo não precisa ser complexa — mas precisa ser intencional.

Checklist executivo:

- Mapear onde e como a IA está sendo utilizada

- Definir níveis de acesso por perfil e função

- Integrar IA às políticas de identidade (IAM)

- Estabelecer monitoramento e auditoria de uso

- Criar diretrizes formais de AI Governance

- Avaliar plataformas de GRC para suportar essa jornada

🎯 Conclusão: o futuro da IA será definido pelo acesso — não apenas pela capacidade

A evolução da inteligência artificial está entrando em uma nova fase.

Uma fase onde:

- capacidade sem controle gera risco

- acesso sem governança gera vulnerabilidade

O diferencial competitivo não estará apenas em usar IA —

mas em controlar, com inteligência, quem pode usá-la e como.

📣 Como a InfoChoice pode apoiar sua jornada

A adoção segura de inteligência artificial exige mais do que tecnologia — exige estrutura, governança e estratégia.

A InfoChoice apoia organizações na:

- definição de modelos de AI Governance

- integração com frameworks de GRC

- estruturação de políticas de acesso e risco

- avaliação e implementação de plataformas especializadas

Se a sua organização já está utilizando IA — a próxima pergunta não é “se”, mas como governar esse uso com segurança e escala.

Podcast e Análise Imersiva

Infográfico

Mapa Mental

Deixe um comentário