A inteligência artificial conversacional acaba de atravessar uma nova fronteira.

Nos últimos anos, plataformas de IA evoluíram rapidamente: começaram como assistentes de produtividade, passaram a atuar como copilotos profissionais e hoje já funcionam como interfaces permanentes de interação humana. Mas o mais recente anúncio da OpenAI mostra que a próxima etapa dessa transformação vai muito além da automação.

Com o lançamento do recurso “Trusted Contact” no ChatGPT, a empresa introduz um mecanismo que permite ao usuário cadastrar um contato confiável para situações críticas envolvendo risco severo identificado durante conversas com a IA.

À primeira vista, parece apenas mais um recurso de segurança.

Na prática, é um sinal claro de que a IA deixou de ser tratada apenas como software — e começou a ser projetada como infraestrutura de confiança humana.

O que é o Trusted Contact

O Trusted Contact é um recurso opcional que permite ao usuário adulto cadastrar uma pessoa de confiança para ser acionada em situações extremas de risco detectadas durante interações com o ChatGPT.

Segundo as informações divulgadas, o sistema combina:

- detecção automatizada de sinais críticos;

- protocolos internos de avaliação;

- revisão humana antes de qualquer acionamento;

- limitação do compartilhamento de informações.

A OpenAI afirma que o recurso foi desenhado para preservar privacidade, evitando o envio integral do histórico das conversas ao contato indicado.

O mais importante, porém, não está apenas na mecânica da funcionalidade.

Está no que ela representa.

Porque esse anúncio reconhece oficialmente algo que o mercado já percebeu há algum tempo: milhões de pessoas passaram a usar IA conversacional como espaço de apoio emocional, aconselhamento cotidiano e diálogo permanente.

A IA está deixando de ser apenas ferramenta

Durante décadas, softwares operaram em um papel relativamente previsível:

- executar tarefas;

- processar dados;

- automatizar operações;

- responder comandos.

A IA generativa mudou essa dinâmica.

Modelos conversacionais modernos possuem:

- memória contextual;

- comunicação natural;

- persistência de interação;

- capacidade adaptativa;

- personalização contínua;

- comportamento aparentemente relacional.

Isso altera profundamente a forma como humanos se conectam com sistemas digitais.

Na prática, muitas pessoas já interagem com agentes de IA como:

- assistentes pessoais;

- conselheiros;

- organizadores cognitivos;

- espaços seguros de conversa;

- companhias digitais permanentes.

O Trusted Contact surge exatamente nesse contexto.

E talvez seja uma das primeiras evidências públicas de que as plataformas de IA começaram a reconhecer oficialmente essa nova responsabilidade.

O nascimento da “Trust Layer” em IA

Existe uma mudança estrutural acontecendo silenciosamente no setor de inteligência artificial.

Até recentemente, o foco principal estava em:

- performance;

- capacidade generativa;

- velocidade;

- multimodalidade;

- raciocínio;

- automação.

Agora surge uma nova camada estratégica:

confiança operacional.

Podemos chamar isso de “Trust Layer”.

Essa camada envolve:

- supervisão humana;

- protocolos de segurança;

- monitoramento contextual;

- governança algorítmica;

- mecanismos de escalonamento;

- rastreabilidade de decisões;

- políticas de intervenção;

- contenção de risco.

O Trusted Contact é um exemplo concreto dessa evolução.

Porque ele mostra que sistemas de IA já não podem ser desenvolvidos apenas para responder perguntas. Eles precisam operar dentro de estruturas de responsabilidade.

E isso terá impactos enormes em toda a indústria.

O que muda para empresas e agentes corporativos

O mercado costuma olhar para IA apenas pela ótica de produtividade:

- redução de custos;

- aceleração operacional;

- automação;

- eficiência.

Mas à medida que agentes inteligentes ganham autonomia, memória e acesso a sistemas críticos, surgem novas exigências corporativas.

Empresas precisarão pensar em:

- AI Safety;

- governança de agentes;

- auditoria;

- políticas de supervisão;

- conformidade regulatória;

- LGPD e GDPR;

- trilhas de decisão;

- mecanismos de escalonamento humano;

- limites operacionais de autonomia.

Em outras palavras:

não basta mais que um agente seja inteligente.

Ele precisa ser confiável.

Esse movimento é especialmente relevante porque a próxima geração de agentes corporativos terá:

- acesso a dados internos;

- autonomia operacional;

- integração com ERPs e CRMs;

- capacidade de executar ações;

- memória persistente;

- contexto organizacional contínuo.

Sem uma arquitetura robusta de governança, o risco operacional cresce exponencialmente.

O risco invisível da IA conversacional

Existe um aspecto ainda pouco discutido no mercado:

a transferência emocional para sistemas de IA.

À medida que interações se tornam mais naturais e persistentes, usuários tendem a:

- criar vínculo;

- compartilhar informações sensíveis;

- buscar aconselhamento;

- estabelecer confiança emocional.

Isso transforma plataformas conversacionais em ambientes extremamente delicados do ponto de vista:

- ético;

- jurídico;

- reputacional;

- psicológico;

- regulatório.

O Trusted Contact indica que grandes empresas de IA começaram a aceitar publicamente que esses riscos existem — e que precisam ser tratados estruturalmente.

Essa mudança é importante porque inaugura uma nova lógica:

a segurança em IA não será apenas técnica.

Ela será também humana, contextual e relacional.

A próxima fase dos agentes inteligentes

Nos próximos anos veremos uma evolução acelerada de agentes autônomos operando em:

- atendimento;

- finanças;

- saúde;

- RH;

- jurídico;

- operações;

- vendas;

- suporte corporativo.

Esses agentes precisarão lidar com:

- decisões críticas;

- contexto sensível;

- priorização de risco;

- escalonamento humano;

- compliance;

- confiança organizacional.

O que hoje aparece em um recurso voltado à segurança pessoal pode rapidamente evoluir para:

- protocolos corporativos de risco;

- agentes supervisionados;

- IA com mecanismos de contenção;

- estruturas “human-in-the-loop”;

- arquiteturas de confiança operacional.

O mercado ainda está olhando para IA principalmente como tecnologia.

Mas o verdadeiro diferencial competitivo da próxima década talvez esteja em outro lugar:

na capacidade de construir inteligência artificial confiável em escala.

O verdadeiro significado do anúncio da OpenAI

O Trusted Contact não é apenas um novo recurso do ChatGPT.

Ele representa uma mudança de paradigma.

Mostra que:

- IA conversacional passou a ocupar espaço social relevante;

- segurança deixou de ser acessório;

- governança começa a se tornar parte da arquitetura;

- confiança será um dos principais ativos da nova economia da IA.

Estamos entrando em uma era em que agentes inteligentes não serão avaliados apenas por capacidade técnica, mas também por:

- responsabilidade;

- previsibilidade;

- transparência;

- supervisão;

- alinhamento humano.

E isso muda completamente a discussão sobre o futuro da inteligência artificial.

Conclusão

A evolução da IA generativa está deixando claro que o próximo salto do mercado não será apenas sobre modelos mais poderosos.

Será sobre sistemas mais confiáveis.

O lançamento do Trusted Contact sinaliza que plataformas de IA começam a assumir um novo papel dentro dos ecossistemas humanos — mais próximo de infraestrutura social do que de simples software conversacional.

Para empresas, isso significa que governança, segurança, supervisão e contexto deixarão de ser diferenciais opcionais e passarão a fazer parte da própria arquitetura dos agentes inteligentes.

A próxima geração de IA será definida não apenas por inteligência.

Mas por confiança.

Como a InfoChoice pode ajudar

À medida que agentes de IA assumem funções mais críticas dentro das organizações, empresas precisarão de arquiteturas capazes de combinar automação, governança, segurança e supervisão humana.

A InfoChoice atua no desenho e implementação de soluções de IA corporativa com foco em:

- arquitetura de agentes inteligentes;

- governança de IA;

- segurança operacional;

- compliance;

- AI Safety;

- observabilidade;

- integração corporativa;

- escalabilidade confiável.

Porque no novo cenário da inteligência artificial, performance sem confiança não será suficiente.

Podcast e Análise Imersiva

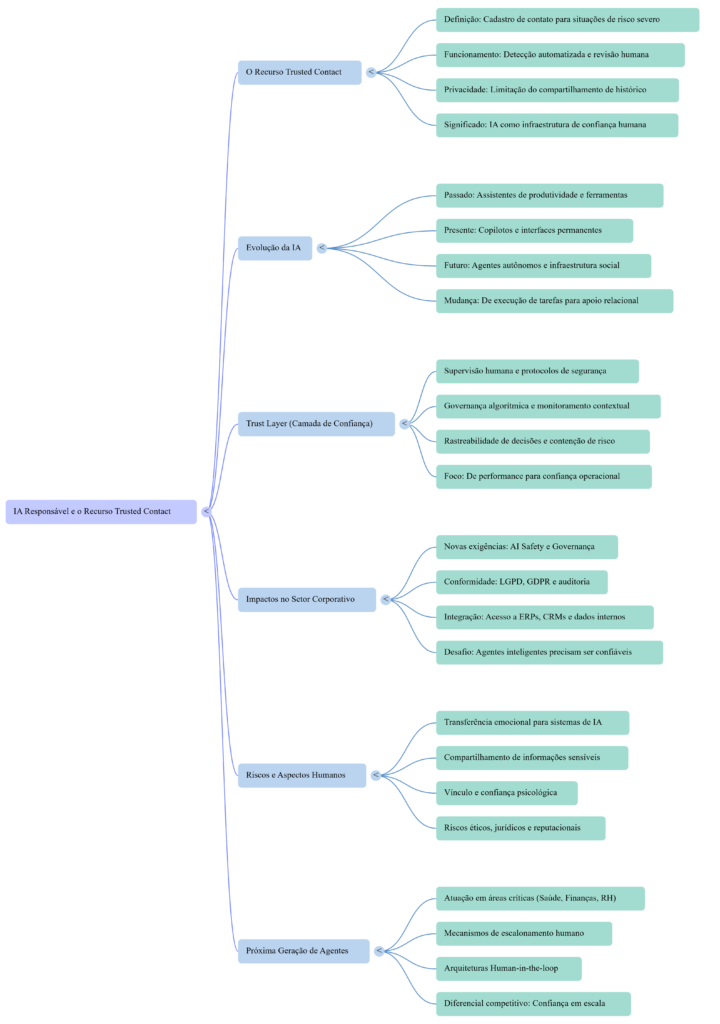

Infográfico

Mapa Mental

Deixe um comentário